Om du tror att du kan klicka på ”Generate” och se miljonerna rulla in på den svenska marknaden – då har jag dåliga nyheter. Det är rent snack. 2026 handlar inte om hur mycket du publicerar. Det handlar om vem som faktiskt litar på det du skriver.

Jag pratade med en webbdesigner förra veckan som hade fyllt hela sin sajt med hundratals generiska texter via en billig tjänst. Resultatet? Google piskade bort dem totalt i den senaste uppdateringen. Problemet är inte själva tekniken bakom AI-textskapande, utan att skräpet saknar själ. ”Vad har själ med det att göra”, frågar du själv.

Table of Contents

Myten om den snabba genvägen

Du har säkert hört sagorna om ”Sven” som byggde en robotsajt över en natt och blev miljonär. Visst, det finns lyckoträffar. Men det är inget du bygger en seriös verksamhet på. Det är som att tro att man blir expert på svensk skatterätt bara för att man läste en broschyr på bussen ner till stan.

Googles algoritmer letar efter mönster. Använder du trötta fraser som ”I dagens digitala värld” eller skriver meningar som alla är exakt lika långa? Då åker du fast direkt. Game over. Se det som ett verktyg för att skissa, inte en magisk knapp som gör hela jobbet.

Hybridmodellen och varför data är lag

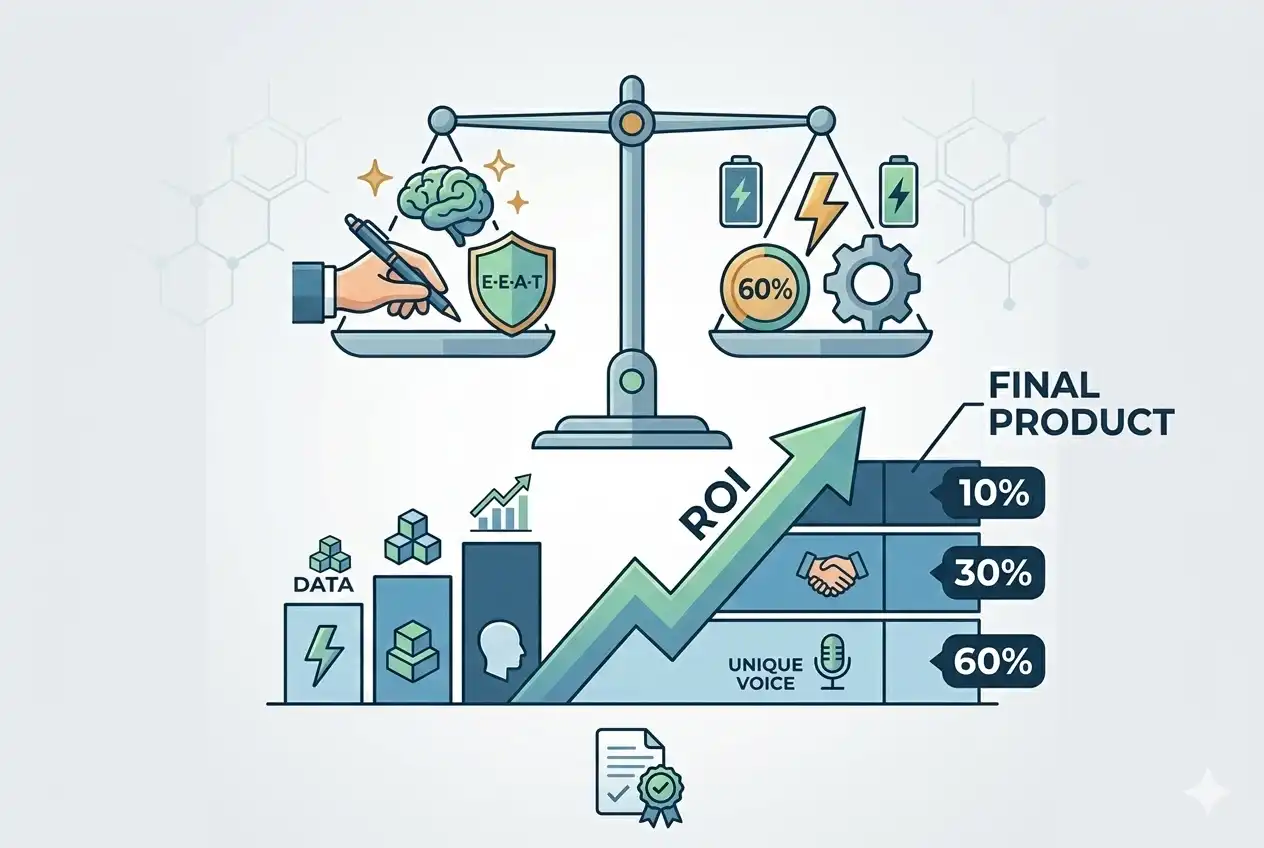

Innan du kastar pengar på automatisering bör du kolla noga på hur marknaden faktiskt ser ut i Sverige och USA idag. Den som kombinerar farten från AI med ett mänskligt öga vinner. Allt annat är en chansning som sällan betalar sig. Hur de metoderna ser ut:

| Metod | Hastighet | SEO Ranking | Förtroende |

| Ren AI | Sekunder | Hög risk | Noll |

| Hybrid | Timmar | Bäst ROI | Högt |

| Manuellt | Dagar | Stabil | Extremt högt |

Siffror ljuger inte, men AI gör det ofta. Om du skriver för en svensk publik – ge dem konkreta siffror från verkligheten. Istället för att skriva ”vårt verktyg förbättrar din SEO”, prova något i stil med: ”Företag som kör vår hybridmodell ser i snitt 43% högre organisk räckvidd efter sex månader.” Använd SCB, branschrapporter eller dina egna siffror. Gör det konkret, annars är det bara brus.

E-E-A-T, AI-textskapande och att våga bryta mönstret

Google struntar egentligen i vem som höll i tangentbordet, så länge du är en expert. Om din text om webbdesign saknar dina egna fallstudier och bittra erfarenheter, varför skulle någon tro på dig? Dela med dig av dina egna ”fuck-ups” och framgångar. Det är så du bygger förtroende på riktigt.

Och för guds skull, glöm den perfekta grammatiken ibland. Människor skriver slarvigt. Vi använder slang, drar interna skämt och skriver korta, slagkraftiga meningar. En bot skriver oftast meningar som alla är 15 ord långa och använder stela övergångar som ”Det är viktigt att notera…”.

Gå in och riv i texten. Klipp bort det stela. Gör texten ojämn – precis som en riktig människa pratar.

Automatisera med hjärna – bygg för framtiden

Marknaden 2026 drunknar i skräp. Volym är aldrig svaret. Publicera två riktigt vassa texter i månaden istället för tjugo halvdana. Uppdatera dina gamla inlägg med ny data. AI ska vara din acceleration, inte din ersättare.

Många agenter lovar guld och gröna skogar genom total automation. Var försiktig där. Om du inte är hundra procent säker på att de faktiskt fattar hur man navigerar runt Googles spam-filter, så backa. Annars sitter du där med en fet nota för en sajt som ingen besöker.

Är det värt besväret? Det vet bara du. Men de som vinner 2026 är de som fattar att tekniken ska förstärka mänsklig expertis, inte byta ut den. Envishet och kvalitet lönar sig alltid i längden.

Lycka till med att erövra marknaden.

Läs mer om SEO, lokalisering eller nya tränder på min blogg.

FAQ

Kan Google straffa min webbplats för att jag använder AI-texter?

Google straffar inte teknik i sig, utan innehåll av låg kvalitet. Om din text saknar mervärde, data och expertis (E-E-A-T) riskerar du att tappa din ranking. Ren AI-automation utan mänsklig kontroll ses ofta som spam.

Vad är den bästa strategin för AI-textskapande 2026?

Den mest effektiva metoden är hybridmodellen. Det innebär att AI sköter det första utkastet och strukturen, medan en människa redigerar innehållet, lägger till unik data och personlig röst för att säkerställa högsta möjliga ROI.

Hur upptäcker Google och läsare att en text är skriven av AI?

Typiska tecken är en alltför perfekt och enformig struktur, stela övergångsfraser (som ”Det är viktigt att notera”) och brist på personliga åsikter eller specifika fallstudier. Texter som saknar mänsklig ”imperfektion” flaggas lättare av algoritmer.

Varför är data så viktigt för innehåll på den svenska marknaden?

Svenska och internationella användare 2026 kräver transparens och auktoritet. Generiska påståenden räcker inte längre. Genom att inkludera konkret statistik från källor som SCB eller egna branschrapporter bygger du det förtroende som krävs för att konvertera besökare.

Är det bättre att publicera många AI-texter eller få mänskliga texter?

Kvalitet vinner över volym 2026. Det är betydligt bättre att publicera två välresearchade texter med hög auktoritet per månad än tjugo halvdana texter som bara skrapar på ytan.

Källor:

1. GPT detectors are biased against non-native English writers

Detta är den mest citerade studien från Stanford University som bevisar att AI-detektorer ofta flaggar texter skrivna av människor (särskilt de med annat modersmål än engelska) som AI, på grund av deras mer förutsägbara ordval.

2. Google Search’s guidance about AI-generated content

Googles officiella dokumentation och policy som fastställer att de prioriterar innehållskvalitet och E-E-A-T (Expertise, Experience, Authoritativeness, Trustworthiness) framför huruvida en text är skriven av en människa eller AI.

3. Creating helpful, reliable, people-first content

Denna guide från Google Search Central förklarar vikten av ”Experience” (den fjärde bokstaven i E-E-A-T), vilket är den avgörande faktorn för varför ren AI-text ofta misslyckas med att ranka högt 2026.

4. Can AI-Generated Text be Reliably Detected?

En omfattande studie från University of Maryland som analyserar svårigheterna med att upptäcka modern AI-text och förklarar varför statistiska mönster (perplexitet och burstiness) är de enda indikatorerna som detektorer kan använda.

5. Watermarking Chatbots: Analysis and Case Studies

Forskning rörande ”digitala vattenstämplar” i LLM-modeller (Large Language Models), vilket förklarar hur företag som OpenAI arbetar för att göra AI-genererat innehåll spårbart på en algoritmisk nivå.

Lämna ett svar